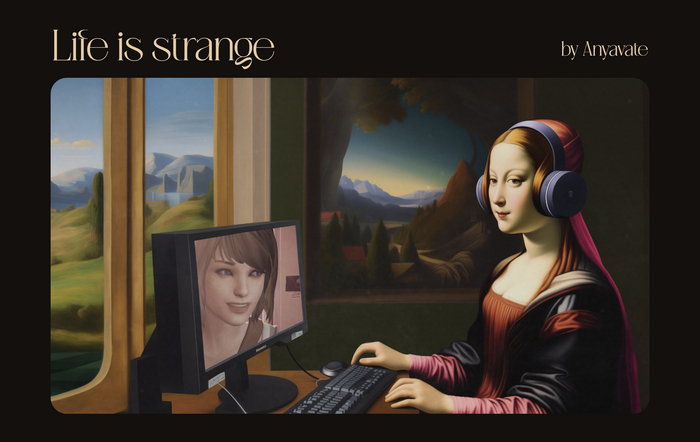

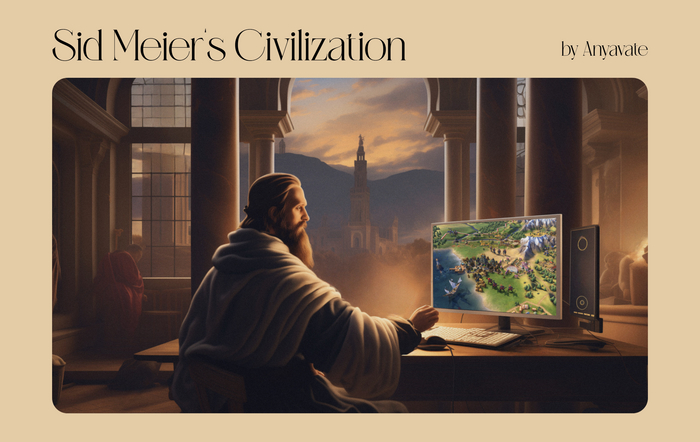

Когда в эпоху Возрождения завезли компьютеры, игры и зум

Создала серию нейрокартинок, где объединила стиль Ренессанса и современность. Продолжение на моем телеграм-канале 😉

Создала серию нейрокартинок, где объединила стиль Ренессанса и современность. Продолжение на моем телеграм-канале 😉

Столкнулась с тем, что моих знаний в области ИИ не хватает, а всеведущая сеть интернет мне помочь не может. Надеюсь на совет от креативных пикабушников 🙏

Задача: Нужно сгенерировать некоторое количество картинок одного и того же персонажа по текстовому описанию в разных ракурсах и позициях на нейтральном фоне.

Все нейросети, которые я мучала на эту тему, могут генерировать только разных персонажей по описанию.

Думала также о том, что можно при помощи одного ИИ персонажа создать, а при помощи другого - "расшевелить", но не нашла подходящих сервисов.

Всю голову сломала, не знаю, как провернуть сию операцию. Буду рада любым подсказкам, чтобы понимать хотя бы, в какую сторону "копать" дальше.

Сама кодить не умею и возможности ставить на ПК тяжелые проги нет, к моему большому сожалению.

Спрашивала также у самих ИИ, но те ответ не дают, хотя промты были довольно детальными.

Взять с собой побольше вкусняшек, запасное колесо и знак аварийной остановки. А что сделать еще — посмотрите в нашем чек-листе. Бонусом — маршруты для отдыха, которые можно проехать даже в плохую погоду.

Вчера Кандинский обновился до версии 2.2. Решила сравнить его с предыдущей версией и заодно проверить, начал ли он догонять известную нейросеть Midjourney. Итак, спойлер: он пока еще не дотягивает до уровня Midjourney, но новое обновление вышло действительно интересным!

В обзоре буду сравнивать версии 2.1 и 2.2, используя один и тот же промпт. И чисто из интереса те же промпты выдам Midjourney.

Идеи для промптов брала на сайте Prompt Hero — постаралась выбрать разные тематики. Кандинский понимает запросы и на русском, и на английском, так что переводить их не стала.

Вот что пообещали разрабы:

Генерируемые изображения стали более фотореалистичными;

Теперь можно указывать соотношения сторон будущего изображения. Раньше генерируемые изображения были ограничены квадратным форматом 1:1;

Функционал ControlNet: он предоставляет вам возможность вносить локальные изменения на картинке без изменения всей сцены.

Решила начать с портретов, чтобы проверить, насколько изображения стали более реалистичными

a commercial photo portrait of stunning instagram model, sparklecore, appropriation artist, shiny/glossy, clear edge definition, unique and one-of-a-kind pieces, light brown and light amber, Fujifilm X-T4, Sony FE 85mm f/1. 4 GM

Кандинский 2.1 vs 2.2

Сразу заметна разница. Хотя с первого взгляда и видно, что это не фотография живого человека (либо сильно отфотошопленная версия), но результаты уже получше. Для сравнения вот такую фотореалистичность сейчас выдает Midjourney:

Не удержалась и решила провести эксперимент на Папе Римском. В этот раз обойдемся без переодевания его в белый пуховик (вы еще помните тот тренд с Баленсиагой?), а отправим его в Майами в 80-е годы.

Pope Francis in 80s Miami Style

Кандинский 2.1 vs 2.2

Вот тут вообще не впечатлило. Версия 2.1 получается даже более интересной и оригинальной. Да и цветовая гамма у нее сразу ассоциируется с розовым стилем и пальмами, о которых думаешь, когда слышишь о Майами 80-х. Версия 2.2 от Кандинского имеет излишнюю желтую насыщенность, это кстати сильный минус новой версии. Кажется, в 2.1 этого было меньше. Ну ладно, пойдем дальше.

Кстати, вот вам версия от Миджорни:

Несмотря на колоссальную разницу в качестве, 2.1 и Midjourney в общем-то попали в один вайб!

Ладно, давайте оставим фотореализм на время и сделаем что-то забавное и мультяшное. Вот промпт, который мы выбрали:

a cartoon of an astronaut in space full of other characters, in the style of dreamscape portraiture, youthful protagonists, dark cyan and bronze, vibrant murals, lit kid, photorealistic renderings, intricate underwater worlds

Кандинский 2.1 vs 2.2

Есть впечатление, что новая версия стала чуть более... скучной? Я пробовала этот промпт в разных стилях — и в мультфильме, и в аниме, и во всяких разных. Однако все равно получается некая «пустоватая» картинка с характерной засвеченностью. В общем, хочется снова отдать свой голос за предыдущую версию.

А вот Midjourney:

Как будто бы они тут с 2.1 опять мыслили в одном направлении. У Кандинского даже персонажи на заднем фоне повеселее вышли :)

Одно из интересных применений нейросетей — генерировать референсы для предметных съемок. Давайте попробуем создать рекламу бургера!

Flying food photography with a burger as the main theme, splash of toppings and spices, cheddar flavored cheese, onion, pickles, sesame Bun

Кандинский 2.1 vs 2.2

Опять же, версия 2.1 действительно проявляет больше фантазии, здесь и соусы, и кусочки бургеров. Зато вот у 2.2 получается гораздо реалистичнее.

И вот такой результат показывает Midjourney:

Давайте попросим нейросеть нарисовать для нас интерьер дома с большими окнами, открытой планировкой и использованием натуральных материалов.

open spaces that are arranged to be viewable, in the style of ludwig mies van der rohe, light brown and light amber, post-war french design, voigtlander brilliant, balcomb greene, use of common materials, windows vista

Кандинский 2.1 vs 2.2

Девиз 2.2: Еще больше желтизны богу желтизны...

Давайте еще раз вернемся проверить фотореалистичность. Хочется ленивца!

A photo of a cute sloth swimming in a river, summer day

Кандинский 2.1 vs 2.2

Ну, стало чуть более реалистично. Но все равно заметна повторяющаяся проблема с излишней насыщенностью.

Забавно наблюдать, как Midjourney и версия 2.1 выдают примерно похожие результаты:

В телеграм-боте Кандинского появились новые функции взаимодействия с изображениями, например возможность «смешивания». В этом режиме, по аналогии с функцией «remix» в Midjourney, вы можете загрузить изображение и написать тестовый промпт. Тогда нейросеть не только сгенерирует изображение, но и возьмет за основу загруженное изображение.

Решила поэкспериментировать с портретом девушки, который сгенерировала ранее, и в промпте написала всего одно слово: смокинг

Вышло интересно, вот это мне понравилось :)

Очень похоже на функцию смешения. Здесь вы можете использовать одно изображение в качестве основы и передать его стиль другому. Не нужно дополнительно писать, что вы хотите получить — нейросеть все сделает сама.

Нажала «смешать картинки» и получила это:

Функции смешения и переноса стиля тянут потестировать их еще. Можете загружать свои фотографии и использовать их в качестве основы для генерации других изображений с разными стилями. Поле для экспериментов огромное!

Выбираете соответствующую команду в меню тг-бота, вводите промпт, и получаете изображения, которые можно сразу же использовать для создания стикерпака прямо в телеграме:

Новые функции 2.2 мне зашли. В них не нужно долго разбираться да и проблем с ними не возникло.

Конечно, Кандинский, несмотря на свои достоинства, уступает Midjourney во многих аспектах. Но учтем, что Midjourney имеет больший объем данных для обучения — будем верить, что у Кандинского еще все впереди :D

Недостаток обновления, который сильно расстроил — «безликость» и желтизна получаемых изображений. Кроме того, несмотря на увеличение количества стилей до двадцати, разница между ними оказалась не всегда заметна и особого восторга не вызвала.

Как вам обновление? Успели затестить?

Источник: Нейросекта

Привет, Пикабутяне!

В марте было совсем мало времени на творчество, поэтому один месяц своего челленджа я запорола. Челлендж в том, чтобы выкладывать на ютаб хотя бы один ролик в месяц) Это реально сложно, когда у тебя есть работа, отношач, дела в виде приезда родственников, гулянок и прочего, прочего…

Однако я стремлюсь к качеству контента, не только к количеству, так что этим роликом я крайне довольна. Давайте расскажу в чём его суть:

Нейросети. Нейросети и творчество. Да, про нейросети уже давно визжат из всех щелей, но мне же тоже интересно опробовать их в творчестве. Я, как исследователь и поклонница технологий, решила создать книгу с помощью нейросетей. Название тоже выбирала одна из сетей)

Что произошло дальше? Я отправила свою книгу в несколько книжных магазинов города и провела несколько экспериментов. Я хотела узнать, как люди будут реагировать на мою книгу, что они вообще думают на счёт использования современных технологий в создании художественной литературы.

Результаты эксперимента были фантастическими! Я разговаривала с людьми, дурачилась, показывала им книгу и задавала вопросы. В стиле старого-доброго «Серёжи и микрофона»..

Помимо этого я пригласила эксперта – Внука Елькина, который объяснил, можно ли продавать нейросетевое творчество и что будет с профессиями писателей и художников в будущем (он очень много дельного поведал мне, думаю, надо из исходника сделать отдельный видос)

Так что же это значит для нас? Это означает, что нейросети могут стать одним из самых важных инструментов в нашей жизни, и мы можем использовать их для создания чего-то нового и уникального. Возможности бесконечны, и я не могу дождаться, чтобы узнать, что нам предложат нейросети в будущем!

Обязательно посмотрите видос и расскажите, как вы используете нейросети.

+ там ещё розыгрыш одной книги из видоса будет, тоже предлагаю поучаствовать. Всем добра!

Ребят, а вы сами пробовали генерить нейросетью? А то все супер посты как нейросеть что то нагенерировала, хотя либо это 1 на миллион удача - либо нарисованно человеком по мотивам сегенерированного нейросетью.

Вот я вам покажу разницу ожидание-реальность пример того что генерирует нейросеть, топовая DALE-E-2 на хуманизацию машин.

Вот хонда:

Вот альфа ромео:

Крупным планом:

Лексус:

Вот я пытала нейросеть чтоб получить три однотипных иконки для приложения с изображением солнца-тучек, ну иконы я тут вижу да. , второй результат без слова "иконки", со словом "картинки"

Уже слышу крики с дивана - Машка, да ты подробнее описывай, нейросетке то нужно детали и конкретику.

Вот тут я очень конкретно просила два бассейна, один с розовой водой - другой с обычной. Причем сама нейросетка же описание и сделала, и не смогла по своему описанию нарисовать, бассейн везде один:

Куча запросов ушло на то чтоб нарисовать милую картинку кактуса в горшке, но чтоб на горшке не было глаз. Все мимо - милая - значит глаза на горшке. И нейросеть не колышет что я прямо прошу глаза на горшке не рисовать.

Нарисовать серию однотипных картинок нужных для приложения, чтоб на них было то что запрошенно - почти нереально. Фон для приложения я смогла использовать только после 20 генераций и еще пришлось доработать руками.

Слышу другие возгласы в дивана - Машка, да этож дело не нелегкое, надо тебе поучится больше чем пару дней.

Во первых не забываем что такое обучение платное, каждый запрос - денежка

Во вторых сетка меняется и обучается каждый день сама, и то что сегодня дает нужный результат - завтра мимо.

И в третьих - если уж я трачу время и деньги на обучение - я лучше научусь сама рисовать (пиксель арт не требует поставленной руки и высокого художественного вкуса)

В общем расходимся - чем использовать для генерации картинок нейросеть проще и эффективнее на эти деньги нанять человека-дизайнера.

С 80-х годов эта тема с нейросетями, учатся-учатся - все не научатся. Да, современные мощности позволяют генерировать что то сложное, но абсолютно бесполезное, и этот порог непреодилим принципиально, по все тем же причинам, что нейросеть это тупо случайная компиляция, а не высокоинтеллектуальная.