Инвестиции в Миллиарды: Почему Обучение GPT-5 Может Сломать Банк?

🌐 Искусственный интеллект и гонка технологических гигантов! 🧠

В современной сфере генеративного искусственного интеллекта 🧠 преобладание принадлежит модели GPT-4, разработанной компанией OpenAI 🏭. Тем не менее, нарастающая конкуренция со стороны таких проектов, как Claude от Anthropic и Llama от Meta, обладающих открытым исходным кодом 👾, активизирует дискуссии относительно будущего развития флагманских языковых моделей OpenAI. В то время как общественность с интересом ожидает анонса GPT-5 🚀, предполагаемого к выпуску в 2024 году, эксперты предупреждают о возможных задержках связанных с необходимостью значительных инвестиций в ресурсы 💰.

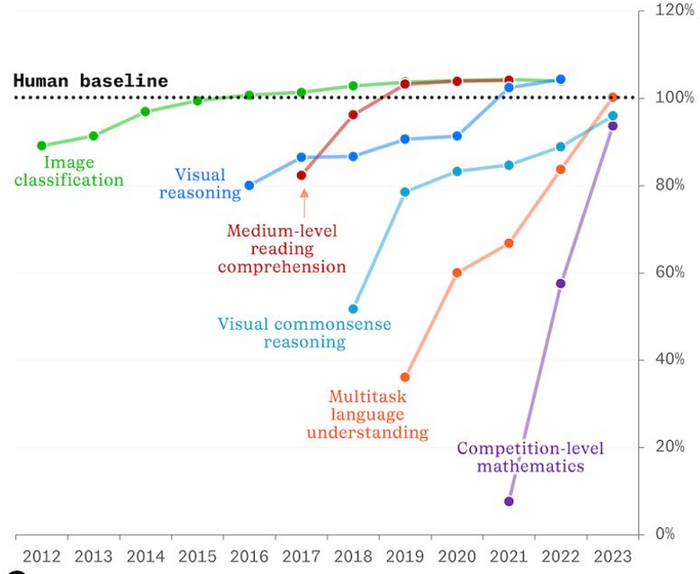

По мнению Дэна Хендрикса, директора Центра безопасности ИИ, каждое новое поколение модели GPT требует существенного увеличения вычислительных мощностей 💪. Переход от четвертой к пятой версии предполагает увеличение необходимых ресурсов в сто раз, что эквивалентно круглосуточной работе миллиона графических процессоров H100 на протяжении трех месяцев 🕒.

Дарио Амодеи, генеральный директор Anthropic, подтверждает эти выводы, указывая на текущие затраты на обучение языковых моделей, составляющие около $1 млрд, и прогнозируя их рост до $5-10 млрд к 2025 году 🔝.

Также стоит отметить, что растущие потребности в вычислительных мощностях сопровождаются увеличением энергопотребления 🔌. Прогнозируется, что в 2027 году глобальное энергопотребление центрами обработки данных может достичь 85-134 ТВтч, что подчеркивает необходимость поиска более эффективных методов обучения моделей 💡.

В этом контексте эксперты высказывают предположение о том, что для сохранения конкурентных преимуществ OpenAI может потребоваться оптимизация процесса обучения, который в настоящее время зависит от обширных наборов данных, собранных из человеческих диалогов 🗣️. Это может привести к разработке промежуточной версии модели, GPT-4.5, вместо прямого перехода к GPT-5.

Первоисточник